Biosmog a écrit :

TheSoulsRemain a écrit :

skynet a écrit :

Biosmog a écrit :

L'idée que l'IA s'autonomise, je pense que ça fait partie de la propagande techniciste qu'on essaie de nous faire gober. Il y a des dizaines de milliers de travailleurs derrière les IA actuelles. S'il n'y avait pas ces techniciens de la maintenance de base jusqu'à la conception générale, les IA ne dureraient pas plus de quelques minutes ou se figeraient. Qu'elles parviennnent à produire des oeuvres de l'esprit de plus en plus sophistiquées, ça ne fait aucun doute. Mais

l'autonomie n'existera jamais, ni pour elles, ni pour nous d'ailleurs. Le danger est ailleurs et je pense que ces espèces de chimères qu'on nous agite sont là pour nous faire accepter des choses bien plus graves et bien plus réelles à leur sujet. Notamment, que l'intelligence humaine (l'humanité) se réduit à calculer des systèmes complexes. Que le but de la vie c'est optimiser ces systèmes. Et qu'il faut qu'on adhère à cette vision des choses pour réussir sa vie.

Tu as ton point de vue. Il semble que des gens éminents en ont un autre. On va simplifier : t’as raison.

Je ne doute pas de tes solides connaissances sur le sujet, de mon côté, je ne comprend pas comment une personne intelligente ne puisse envisager une situation autrement que de son point de vue.

![]()

L'IA s'autonomise et c'est factuel.

Rappelons que la crainte des premiers scientifiques qui ont tenté d'écrire un livre blanc là dessus c'est que l'IA "s'échappe" par courant porteur, donc leurs unités de travail ne devait pas être connectés aux réseaux environnants ni par informartiques ni par électricité. Ça s'était il y a peut-être 8 10 ans.....

Le but de l'IA et de ce qui va avec c'est qu'à terme ces machines/outils/aides deviennent 100% autonomes et que leur self learning ne s'arrête pas.

La recherche d'efficience ira obligatoirement dans ce sens.

https://www.safe.ai/

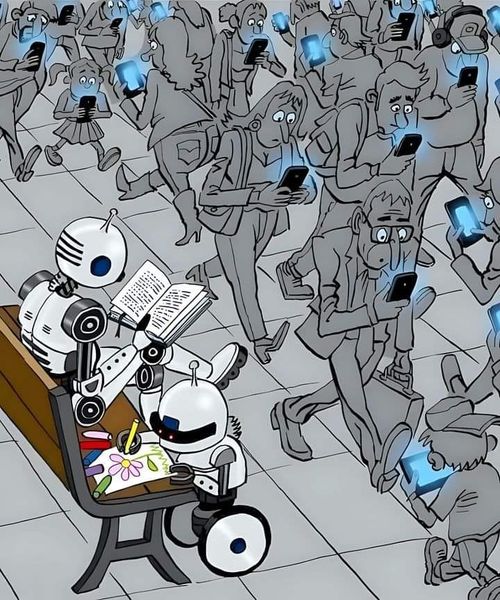

Quand on parle d'un système technique autonome, ce n'est pas du tout dans le sens qui était mentionné plus haut, de la machine qui s'échappe de tout contrôle et peut potentiellement se retourner contre nous. En fait, le danger de l'IA c'est plutôt que nous perdions notre autonomie en lui confiant ce qui nous importe. C'est dans ce sens que la machine peut se retourner contre nous. Comme dit lo-fi reup, il y a une confusion avec les récits de science fiction qui dessinent des robots vengeurs ou je ne sais quoi. La fin du monde à cause des robots ne va pas du tout se passer comme ça (si elle se produit).

Le danger potentiel de l'IA est tout autre. Il est que, comme tout développement technique, elle n'est pas neutre, elle donne une direction dont nous devenons dépendant. Ce danger il est donc plus vicieux. Le danger de l'IA est qu'on ne soit plus capable de s'en passer pour assurer l'alimentation en électricité d'un pays, pour évaluer un projet complexe, ou au niveau individuel, pour formuler une communication. Et les alertes "sérieuses" sur les dangers de l'IA parlent plutôt de ça, à ma connaissance. C'est un peu le contraire de l'autonomie.

C'est pour ça qu'on parlait de toutes les ressources humaines nécessaires pour faire fonctionner concrètement une IA. L'autonomie est un leurre, on est dans un monde où de moins en moins de choses sont autonomes, où chaque chose a besoin de la collaboration d'un plus grand nombre de personnes, sur l'ensemble du globe, pour fonctionner. La masse de travail humain cumulé nécessaire pour que chatgpt tourne est proprement faramineuse: c'est une pyramide qui demande la collaboration de milliards de personnes. On pourrait décrire le problème auquel nous sommes confrontés à l'envers: le jour où la technologie s'effondre, toute cette masse de travail cumulé disparaît (les bibliothèques numériques, les systèmes de calculs, les oeuvres d'art numérisées, etc.)

Quand le chaos s’installe, bien malin est celui qui sait dans quel sens ça va aller.